运输有特殊处理需求的货物(也称为特殊货物)的航空货运业经常处理不透明的数据和过时的技术,导致效率低下。特殊货物本体是一种提取、构造和存储领域知识并表示可由计算机处理的概念和关系的方法。该本体可作为许多人工智能应用中语义数据检索的基础,如特殊货物运输规划。领域信息提取是实现和维护特种货物本体的重要环节。然而,领域信息的缺失使得货物本体的实例化具有挑战性。我们提出了一种基于分层注意的多任务模型的关系表示学习方法,并将其应用于特殊货物领域。将提出的关系表示学习体系结构应用于特殊货物本体中各种关系类型样本的识别和分类。该模型使用特定于领域的文档在许多语义任务上进行训练,这些语义任务从底层的轻量级任务到分层设置中模型顶层的重量级任务不等。因此,它传达了互补的输入特征,并学习了丰富的表示。我们还训练了一个特定于领域的关系表示模型,该模型仅依赖于货物运输领域的实体链接语料库。然后将这两种关系表示模型用于称为特殊货物关系提取器(SCRE)的监督多类分类器中。实验结果表明,所提出的关系表示模型能够有效地表示特殊货物领域的复杂语义信息。

数字技术的使用不再是可有可无的,而是在许多行业中保持竞争力的必要条件。航空运输业就是其中之一。然而,在航空货运业的数字化进程中,对特殊货物运输的关注却很少[1]。特殊货物(或称特殊货物)是指在运输过程中需要特殊处理的物质(如对温度要求严格的药品、活体动物、化工、食品等)。特殊货物运输过程的管理依赖于各种领域数据。在实践中,这些数据通常是大量的,并且具有不同的粒度、格式和有时不明确的属性。本体可以通过概念化和结构化领域知识来有效地解决这些挑战。它们被用于许多应用中,如语义集成和推理、路由和特殊货物运输中的各种操作决策。它们还可以在问答任务中被利用,用于关于特殊货物路由的特定查询。

例如,货运代理的路线规划可以从先进的信息提取和本体中受益。特殊货物产品的路线规划(即,为特殊货物运输选择哪些承运人、服务、附加选项和条件)可能是一项复杂的任务,因为路线决策的可能性可能非常高。最近的一个例子是COVID-19疫苗的运输,需要谨慎的路线决定。航空货运代理通过在行业合作伙伴的帮助下获取与航线相关的必要信息来做出这些决策。如今,大多数作业仍然需要人工干预,作业人员严重依赖专业知识。因此,由于货物的复杂属性(例如,化学特性)以及货运代理和供应商的服务缺乏标准化,获得所有必要的信息可能具有挑战性。人工收集数据效率低,成本高,对整个发货操作的性能产生负面影响[1]。因此,迫切需要开发一个特殊货运能力数据库,提供结构化数据,从中可以检索历史货运数据的特定特征,从而为路线选择建立准确的预测模型。这样的预测模型可以根据性能提供对不同路由选项的快速评估,例如,延迟和/或损坏的概率。

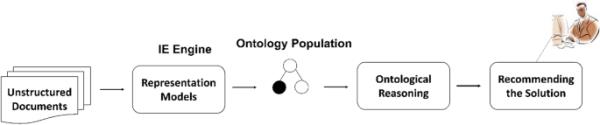

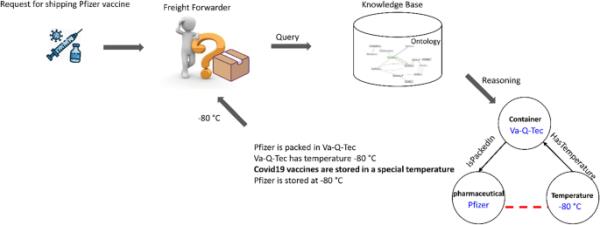

图1显示了如何将我们提出的方法应用于特殊货物运输的一般模式。特别地,所提出的关系表示模型是信息提取(IE)引擎的一部分,该引擎有助于填充本体并将其用于语义推理。一般来说,IE是从非结构化和/或半结构化的海量数据中自动提取有用信息的任务,是本体填充的重要步骤。它被用于自然语言处理(NLP)中的各种任务,如机器翻译[2]和语音识别[3]。IE的其他高级相关任务包括处理重复过程和干扰[4,5]以及应用迭代学习控制(ILC)方法的建筑温度控制[6]。ILC利用之前的实验数据来处理重复的控制过程,并通过学习历史信息来提高对重复过程的跟踪性能。

图1

为应用中本体的使用提供了一种通用模式。IE引擎帮助填充本体并将其用于语义推理

在特殊货物领域,抽取可用信息填充本体也起着至关重要的作用。关系抽取是IE中的一项基本子任务,它有助于识别本体概念实例之间的关系,并获取和分类本体实例。在本文中,我们从大量资源中提取和构造特殊货物信息,实例化利用知识提取和UPON (Unified Process for Ontology)技术构建的特殊货物知识资源[7]。本体论推理的结果可以帮助航空货运代理的管理者进行路线决策。

关于特殊货物领域的主要信息可以在货运代理和航空公司的网页上找到。各种数据源使用不同的模板、结构和语言来表示数据。这些来源是非标准的,并且包含大量不同的术语。用不同的方式表达相同的信息是很难匹配的。此外,缺乏资源术语在实践中是一个很大的挑战。海量的数据使得人工提取信息的成本很高。本研究的目的是建立最小可用样本的深度神经网络模型,以获取特殊货物领域的信息。特别是,本研究解决了提取特殊货物领域知识的挑战,以便在最少的人为参与和缺乏足够数量的训练样本的情况下实例化本体,以开发鲁棒模型。实验结果表明了特殊货物关系表示模型在关系提取和少镜头关系匹配两个任务中的有效性。few -shot学习是一种机器学习方法,它使模型能够从少量标记数据中学习,通常每个类的示例很少。它旨在通过利用从相关任务或领域学习到的先验知识,在最小的监督下快速适应和推广到新任务或领域,从而解决有限标记数据可用性的挑战。近年来,在故障诊断等不同领域中,Few-shot得到了广泛的关注。MAMN[8]是解决数据驱动故障诊断中故障样本稀疏和数据跨域问题的智能故障诊断模型。该方法的核心是将样本组的相对相似信息与数据域之间的元信息相结合。

本文的主要贡献如下:

针对特殊货物领域的关系表示学习,提出了一种新的基于分层注意的多任务学习体系结构,并将其应用于多类关系分类任务中。该模型简单、健壮且与领域无关。

使用迁移学习,我们研究了利用基于双向编码器表示的变压器(BERT)关系提取模型作为特征提取器,用于特殊货物运输领域的多类关系提取。

本研究是在运输信息提取领域,特别是特殊货物运输领域,首次利用深度神经模型进行多类关系提取的研究之一。

我们开发了一个新的数据集,称为特殊货物关系(SCR)。它作为评估数据集公开提供,用于特殊货物运输领域的多任务关系提取任务。

该数据集包含每个关系类型的各种示例,以便使用建议的关系表示模型训练关系分类器。

本文组织如下。在下一节中,我们将回顾相关文献。第3节详细介绍了拟议的架构;第4节和第5节分别描述了数据集的步骤和实验结果;最后,第6节描述了这项工作的实际意义,第7节总结了论文。

一个领域的基础概念的显式和形式化规范被称为本体。本体的组成部分是概念、关系、规则和术语[9,10]。本体可以通过组合现有的本体来手动构建,也可以半自动或自动地使用所谓的本体学习蛋糕[11]。在本体中,存在两种类型的元素:TBox和ABox。

TBox包含本体的概念和关系。ABox包含概念的实现和它们之间的关系。它们是TBox中指定的概念的真实实例。基于输入信息源实例更新本体的过程称为本体填充。当提取的信息符合TBox时,将其添加到ABox中。因此,本体数量不影响本体结构。

在运输领域的某些方面开发了各种本体。交通中断本体论:脚注1收集旅行数据并建立模型,帮助识别对旅行产生破坏性影响的事件。一些本体[12]通过为应急车辆指定有效路线来支持驾驶员的决策。不同的本体,如GenCLOn[13]和iCity ontology(脚注2),旨在获得城市物流和城市系统的领域。虽然在上下文中设计了各种本体,但填充本体是一项复杂的任务。

最近提出了许多本体填充方法,从基本的基于规则的方法和统计方法到复杂的机器学习和混合架构。本节将回顾一些主要技术。

基于规则的方法:这些方法是本体填充任务中最常见的方法类型。它们依赖于许多预先指定的规则来确定目标数据的结构。赫斯特[14]提出了所谓的可扩展的基于规则的技术,使用一些种子样本的自举产生的词典语法模式。由于该方法提取了下义关系,因此可以在本体学习任务中用于生成分类关系。

受Hearst的启发,Finkelstein和Yangarber[15]也提出了一种半自动的基于规则的方法,使用词典句法模式从文本中提取概念和关系实例。这些系统利用专家干预根据一些候选模式生成规则[15]。Ibrahim[16]是一种用于从生物医学文本中提取实例的半自动本体填充方法。在构建生物医学文本句子句法解析树的基础上,由领域专家生成词汇句法模式,用于概念识别。

SOBA[17]是基于规则的自动本体填充系统的另一个例子。基于规则的方法需要对领域有透彻的了解。这些方法的根本缺点是高度需要人际互动[18]。

基于统计的方法:有一些统计本体总体系统使用相似度量和适应度函数来估计提取的信息与本体实例的相似度。Maynard等人[19]提出了统计领域独立系统,从非结构化文本中提取概念实例。[20]中提出了另一个独立于领域的统计系统,该系统使用统计相似性技术为每个提取的概念实例确定正确的类。

基于机器学习的方法:这些模型通常用于填充本体,并分为三大类:监督、弱监督和无监督方法[21]。

Adaptiva[22]是一个领域独立的半自动本体填充系统,它使用概念及其之间关系的种子样本作为输入,使用自举方法识别包含关系示例的句子。Annie是一个用于提取概念的GATE组件。Ontosophie[23]是一种半自动方法,它在特定领域中为关系类型使用带注释的数据。通过应用NLP工具,利用句子的主要成分来归纳提取规则。为提取分配一个置信值,以显示它们的正确程度。Web→KB[24]是一种以Web为中心的机器学习方法,它使用管理HTML页面的工具填充本体。由于现有的网页是不同领域的丰富信息源,因此该方法寻找被识别为种子本体类实例的网页。这些网页通过本体关系进行链接,并检查网页之间的超链接路径。使用三种不同的朴素贝叶斯分类器将网页分类到最相关的类。采用监督一阶归纳学习(FOIL)算法学习本体关系。Mintz[25]为了寻找不同关系类型的不同模式,采用了一种远程监督算法。

开放信息抽取(OIE)系统不局限于一组预定义的关系,可以从大量非结构化语料库中自动抽取任何类型的关系。从SonEX[26]等浅层到SDE-OIE[27]等深层,OIE提取器种类繁多。这两个类别之间的主要区别与它们利用的NLP工具的深度有关。深度提取器处理复杂的结构,如长距离关系;因此,他们在召回方面有很高的表现。OIE系统是基于各种类型的方法设计的,包括通用模式[28]、自举[29]、监督学习[30]和无监督学习[31]。这些系统存在不连贯提取和信息提取不足的问题。

基于深度神经网络的方法:由于特征工程过程是自动完成的,深度神经网络是近年来本体种群研究中备受关注的强大方法。这是深度神经网络模型相对于其他机器学习方法的关键优势。为了从句子中提取词汇和上下文层面的信息,有几种方法使用关系分类和各种深度神经模型,如卷积深度神经网络[32]。然后将提取的特征发送到预测目标关系的softmax分类器中。所有这些方法都需要一个带注释的语料库,其中包含概念及其之间的关系。

MTB[33]是一种独立于任务的方法,用于从实体链接的英语维基百科中学习表示。该方法源自Harris的分布理论,并基于BERT[34]。最近,使用预训练模型构建的系统已经达到了很高的效率[35]。

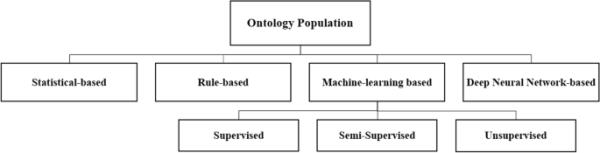

一些本体填充系统是机器学习和基于规则的方法的结合[36]。TR-DOE[10]和RV-DOE[10]是两种混合方法,通过一定的规则依赖于浅OIE和深OIE之间的权衡。BOEMIE[37]是从不同资源中提取信息并对其进行推理的混合本体种群系统。图2显示了本体填充方法的分类。

图2

本体总体方法中关系提取方法的分类。基于深度神经网络的方法在信息提取中得到了广泛的应用

基于迁移的深度神经网络在许多有限数据的自然语言处理任务中取得了显著的成功,并在不同的领域得到了广泛的应用。

本研究是我们之前工作的延伸[38],我们提出了一种针对特殊货物的本体人口框架,并研究了一种构建信息提取引擎的有效方法。在本文中,我们非常详细地描述了分层的基于注意力的多任务架构和生成的数据集。此外,我们提出了一种新的基于匹配空白(Matching the Blanks)方法的特殊货物运输领域信息提取模型[33],并研究了所提模型在一个新任务即少弹关系匹配中的性能。在特殊货物运输领域,由于数据的缺乏,可以从基于转移的神经网络模型的优势中获益。据我们所知,这项工作是在特殊货物领域解决IE的首批研究之一,这在各种智能应用的设计和开发中非常重要。

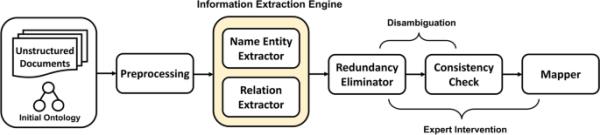

特种货物本体在特种货物运输和全球货运代理、路线规划、交通调度、风险评估和决策系统等方面有着广泛的应用。开发和填充用于运输特殊货物的本体是具有挑战性的。它需要对概念、属性和概念之间的关系进行描述。在[39]中,UPON[7]技术用于产生特殊货物运输的精确概念化。这项工作使用启发方法来组织可用的领域信息,并从领域专家那里获得信息。应该使用领域信息来实例化概念,以填充货物本体。专门用于货物运输的网页、在线文本和数据库包含了丰富的重要信息。需要从许多来源收集所需的知识,并将其连贯地关联起来,以填充货物本体。由于现有的关系提取器在设计时严重依赖于知识图或本体,并且它们之间存在很大差异,因此在特定领域的应用具有挑战性。由于缺乏货物运输领域的注释数据,构造一个有效的关系提取器是具有挑战性和耗时的。本文的主要目标是关系表示任务,它是图3中填充特殊货物的核心组件。我们在[38]中更详细地描述了管道。

图3

填充特殊货物本体的管道[38]。信息提取引擎是特种货物本体填充任务的核心

我们建议一种多任务表示学习方法来克服这个问题,该方法基于从开放领域文献中训练的轻任务,具有自动注释和最少的人为干预。将该模型与基于bert的特殊货物领域关系表示模型进行了比较。我们利用这两个特定的关系表示模型来初始化一个有监督的多任务关系分类模型,并在一个小型的特殊货物领域数据集上对它们进行调优。

现有的基于预训练深度学习的语言模型可以提取不同的特征,并用于多个下游任务[40]。特殊货物领域训练数据的缺乏是开发有效表征模型的最大障碍。手动生成用于多类关系分类的训练数据成本太高。接下来[41,42],我们提出了一种基于层次的方法,该方法建立在一些底层任务的基础上,这些任务对模型底层的浅层任务和模型顶层的深层任务的特征进行编码。我们可以在最小的人为干预下自动为底层任务构建足够的数据集,并将其应用于多任务表示模型设置。因此,构建模型很简单,因为底层任务是使用自动创建的特定于领域的数据进行训练的,这并不昂贵。此外,由于多任务模型利用了跨任务的推理传输,从而在生成的嵌入中补充特征,从而提高了泛化性能[42]。

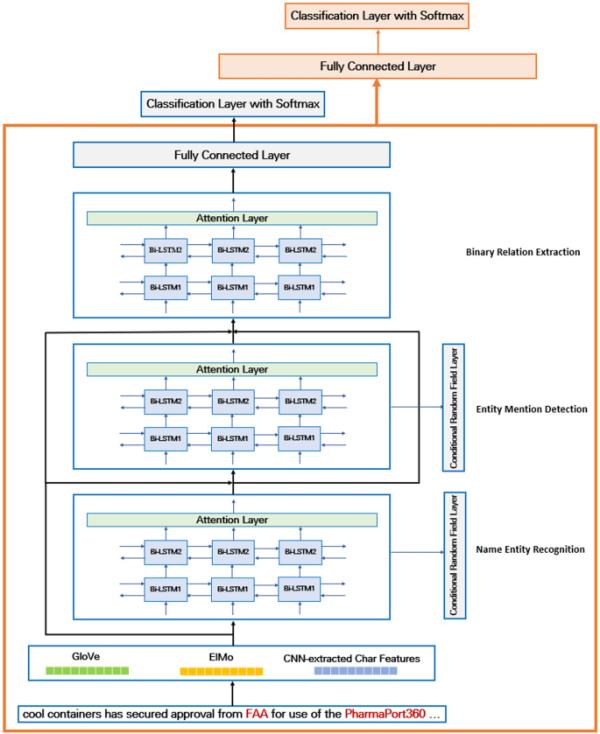

该多任务学习模型可以作为由多类关系分类组成的不同任务中对特殊货物领域的丰富表示。图4显示了多任务表示学习模型的体系结构。

图4

在关系类型分类中,提出的学习关系表示的层次模型。基于层次结构的方法建立在一些底层任务之上,这些任务对模型底层的表面任务和模型顶层的复杂任务的特征进行编码

词嵌入:输入是输入句子的表示,由三种不同的嵌入方法组成,即GloVe[43]用于词嵌入,ElMo[44]用于上下文嵌入,以及基于卷积神经网络(CNN)的模型[45]用于字符级嵌入。这产生了一个全面的输入句子表示,涵盖了从字符到上下文级别的特征。因此,输入句子s=(w1, w2,…,wn)中的每个单词wt被编码为ge,这是连接三个不同的单词嵌入的结果。基于cnn的字符级嵌入算法计算效率高,并且简化了训练过程。在模型的训练过程中,我们使用域数据对GloVe模型进行微调。ElMo为不同情况下的相同输入生成自定义表示。在BERT出现之前,ElMo已经在不同的NLP下游应用中取得了许多成功的结果。为了支持与最近的自然语言模型(例如BERT)进行合理的比较,我们没有将这种嵌入模型作为所提出方法的输入。

名称实体识别(NER):层次模型由三个不同的浅层任务组成。NER是第一个使用条件随机场(CRF)来识别NER标签的底层任务。从嵌入向量中识别名称实体提及,并将其分类为预定的类。将连接的嵌入向量输入到具有注意层的2层BiLSTM网络中。该网络通过取词嵌入ge并生成序列嵌入生成器对输入进行编码。然后将其输入到基于crf的序列标记层中。

注意层通过为每个组件分配显著性值来实现序列数据的编码。它在每个时间步长中生成一个加权向量乘以LSTM得到的特征向量[35]。设H为LSTM输出向量[h1, h2,…,hn]的矩阵,其中n为句子长度。LSTM输出向量的加权和组成句子的表示r[35]。

(1) (2) (3)

式中,H∈,dw为词嵌入大小,w为可训练权向量,wT为转置。w, α, r的维数分别为dw, n, dw。分类的表示是通过:

(4)

实体检测(ED):这是提议的体系结构中的另一个基本任务,类似于NER。与仅关注名称实体的NER相比,ED是一个更广泛的解决方案,需要识别对现实实体的所有相关引用。ED被定义为一个序列标注问题,它利用了一个具有注意层和CRF层的2层BiLSTM。来自底层的表示向量被连接起来,并给出生成表示的编码器。

二元关系提取:从文本数据(RE)中提取名称实体之间的语义关系的过程。这种关系通常涉及两个或多个实体,传统上被认为是一个分类问题。二元关系分类器可以确定一对实体是否具有特定的关系。该任务需要提及检测和分类,我们使用了[46]中开发的联合模型,该模型共同开发子任务。与NER和ED类似,二值关系提取是一个带有一层关注的2层BiLSTM。用一个完全连接层和一个带有softmax的分类层来训练二元关系分类。

上述任务的输出是每个当前任务的输入和整个模型的输入嵌入。编码器将[ge, ge]作为输入,并生成一个表示为gre的表示。前馈网络接收这些表示作为输入。

对于如何训练分层多任务模型,似乎还没有达成共识。我们执行了[42]中提出的成功训练方法。为了训练模型,我们在每次迭代中随机选择一批目标任务的训练数据,并更新任务的参数。任务的抽样是平等的,这个过程是重复的,直到收敛。

多类关系提取:使用特定于领域的数据训练分层多任务架构,并将其用作基于模型和为另一个模型(即多类关系分类器)提取特征的手段。将分层模型的最后一层剔除,其余层用于提取SCREHMTL的特征。

我们可以利用预训练的模型将公共特征转移到我们的领域,因为目标领域中没有足够的数据来训练一个有效的多类关系提取器。因此,使用基本模型并且只有少数实例的目标模型的性能有效地受益于转移的特征。

简而言之,二元分类器利用了特殊货物领域中具有足够数据样本的基于分层注意力的多任务模型生成的丰富关系表示。通过应用从层次结构中获得的关系嵌入来指定模型的最终配置,该关系嵌入作为多类提取器提取特征的一种方式。

本文是我们之前工作的扩展[38],研究了两种不同的转换模型作为提取多类关系类型的关系表示。

航运特种货物航空货运业是一个低资源领域,没有标注数据。为了减少人工生成数据集的工作量,也为了进行比较,我们构建了另一个依赖于实体链接文本数据的关系表示模型。

我们提出了一种基于匹配坯料(Matching the Blanks, MTB)方法的特殊货物域关系表示方法[33]。MTB是谷歌最先进的关系表示,它在一般网络文本中显著优于以前的作品。我们用我们的关系对其建模,并在特定的货物域上对其进行调优,以构建基于BERT的多类关系提取器SCREBERT(EM)+MTB。

我们应用BERT[34]模型对特殊货物运输领域的实体对之间的关系进行编码。BERT是一种基于多个转换层和自监督学习构建的语言模型,它利用大量语料库数据来更好地学习单词的特征表示。它在各种NLP任务中获得了最先进的性能。

关系表示在没有人工注释数据的情况下进行训练,使用纯文本语料库,其中包含链接到唯一标识符的名称实体。关系语句被定义为包含两个标记的名称实体的文本段,并显示为(,,),其中是一系列令牌和和,是确定关系语句中两个实体的索引的范围。

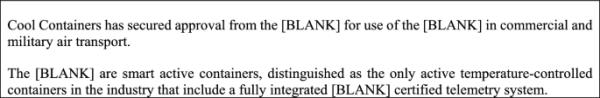

由于该领域的低资源性质和生成训练样本的自动实体解析注释系统的可用性,MTB方法适用于特殊货物领域,通过将带有标记的名称实体替换为特殊符号[BLANK]的关系语句生成训练数据,如图5所示。

图5

两个关系语句共享用[BLANK]标记的同一对名称实体

在训练过程中,MTB为每对关系语句利用一对关系表示,目的是学习一个编码器fθ,该编码器使用以下二值分类器指定两个语句是否表示相似的关系。

(5)

当r和嵌入相同的关系(l=1)或不嵌入(l=0)时,分类器分配一个概率。

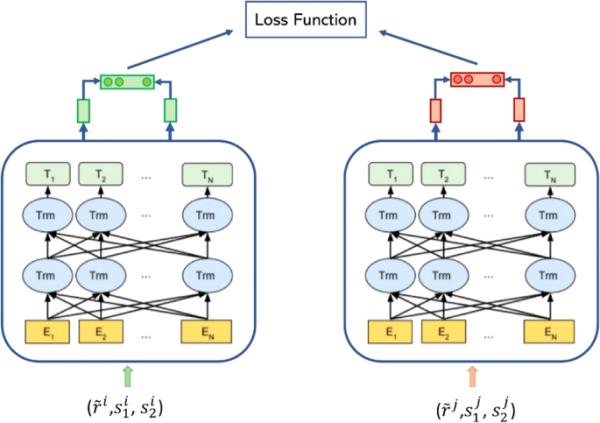

因此,给定一对关系语句,MTB试图学习一个嵌入模型,当它们包含相同的实体对时,它们的内积为高,当实体对不同时,它们的内积为低。这样,编码器就可以使用MTB方法以实体链接文本的形式从远程监督中学习[33]。图6描述了训练过程。

图6

结核分枝杆菌培训过程概述。该图描述了两个不同的关系语句被输入到BERT中。定义分类器来学习一个关系编码器,该编码器用于指定两个关系表示是否嵌入相同的关系。通过最小化损失函数来学习编码器的参数

关系编码器fθ的参数是通过最小化下面的损失来学习的。是克罗内克函数,当e=时值为1,否则为0。

(6)

在训练设置中,BERT和MTB的屏蔽语言模型的损失同时被最小化。第4节描述了训练语料库的生成。我们测试了各种训练数据和BERT模型来训练该体系结构中的关系语句编码器。

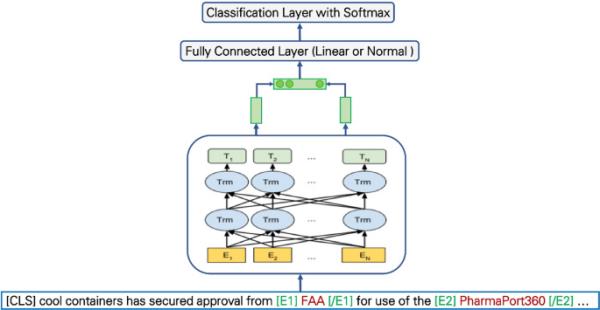

利用领域数据的MTB预训练模型,建立了关系提取模型。使用MTB的关系语句分类体系结构如图7所示。如图所示,目标实体在输入中使用特殊的实体标记进行标记。然后,BERT将标记的句子作为输入,连接与两个实体标记开头相关的状态并检索关系表示。

图7

特殊货物关系分类器的结构。输入中的目标实体(FAA和PharmaPort360)使用特殊标记表示,标记显示每个实体的开始([E1]和[E2])和结束([/E1]和[/E2])。在组合与两个实体标记的开头相关联的状态后返回关系表示

从BERT转换器生成的关系表示被馈送到一个完全连接的层。这一层要么是关系表示的规范化,要么是线性激活函数。选择层类型作为超参数。最后一层是具有softmax激活的分类层,它产生每个类的概率。对于每种类型的关系,可以使用几个实例来训练这些层。

摘要

1 介绍

2 相关工作

3.方法

4 数据集

5 实验

6 讨论及实际意义

7 结论

数据可用性

笔记

参考文献

致谢

作者信息

道德声明

搜索

导航

#####

我们利用不同的资源来评估所提出的模型。本节将更详细地讨论这些来源。

通过从货运网站中提取货运领域相关的货运新闻文本页面和HTML段落,剔除表格和列表,生成学习BERT-base关系的训练数据。总共收集了大约60万个单词。我们使用Google APIFootnote 3用唯一标识符注释语料库文本。在包含40个令牌的窗口中提取至少包含两个实体的关系语句。这些领域关系语句在训练过程中被使用,其中实体被替换为[BLANK]符号。

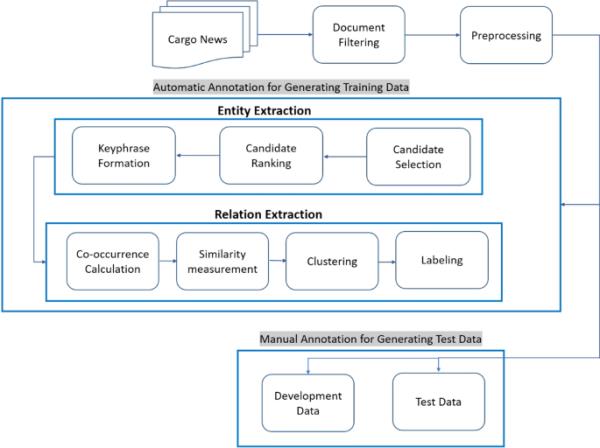

重大的挑战是在特殊货物领域缺乏带注释的资源。在本节中,我们将解释如何构建自动注释来为基于注意力的分层多任务模型中的底层任务生成标记。图8描述了创建训练数据所涉及的过程。

图8

用于训练分层的基于注意力的多任务模型的数据集生成概述。实体抽取和关系抽取是自动标注过程的两个主要组成部分

我们从由正式文本组成的新闻网页中收集了28,809份货物文档来训练二元关系分类器。我们采用了一种自动过滤方法来查找与特殊货物域相关的所有候选文档。在应用潜狄利克雷分配(Latent Dirichlet Allocation, LDA)[47]主题模型后,我们生成了10个聚类。与基于关键字的方法不同,LDA不需要预先确定的关键字列表来进行文档过滤。选择具有更多相关术语的集群作为最具代表性的领域。使用0.9的阈值来保证只捕获高相关性的文档。最后,收集了775条过滤后的文本。

在预处理组件中执行不同的NLP任务,包括句子分割、标记化、NER和词性标注。我们采用全自动标注方法来标记数据,因为深度学习模型需要大量的训练数据,手动生成这些数据的成本很高。实体抽取和关系抽取是自动标注过程的两个主要组成部分。使用无监督的特定领域实体提取框架[48]和NER工具[49]从文本中提取实体。

实体抽取任务由三个主要模块组成。候选选择组件使用启发式方法从已批准的POS列表中选择候选关键字,然后根据候选排名组件中的文本表示对候选词汇进行优先级排序。在关键字生成过程中,对候选关键字进行细化,并生成最终的关键字。我们使用了pke[50],这是一个python的开源库,用于提取关键字,其中包括各种统计和基于图形的技术。根据我们的实验,KPM[51](一种基于统计的技术)和PositionRank[52](一种基于图的方法)在提取特定货物关键短语方面优于其他算法。

图8描述了一般基于聚类的关系提取技术的四个主要阶段。关系抽取任务的输入是来自实体抽取组件的所有句子,以及标记的实体。共现计算步骤提取在定义的窗口大小内发生的一对名称实体及其上下文。同时出现的名称实体对的上下文根据相似性来考虑。这对于集群任务是必要的。我们使用所谓的快速Levenshtein[53]作为基于两个字符串的最小编辑距离的上下文相似度度量计算。我们采用DBSCAN[54]聚类算法,该算法不依赖于预定义的聚类数量。根据我们的评价,由于KPM获得了最高的性能,我们将其作为密钥提取方法。标签组件标记相对于特殊货物域的关系簇。使用带注释的开发集中的模式将集群标记为相关或不相关。

我们从过滤的集合中随机选择223个文档,以便为二元分类器注释它们为相关或不相关并生成测试数据。118个文档由于不合格而被删除,其余的在Dev和Test集合中使用。此外,我们随机选择了10个在线领域文档的数据集。表1显示了数据统计信息。尽管所有的文档都是新闻文章,但与开发集和测试集1相比,训练集每个文档有更多的句子。另一方面,测试集2(在线文档)比训练集包含更多的句子和实体,但每个句子中的单词总数很小。结果表明,与新闻文档相比,在线文档的相关信息密度更大。

表1 ba生成的数据集统计信息对建议的管道进行培训的注意吧Sed分层多任务模型[38]

在货物本体中,有43种不同的关系类型。对于每个关系类型,有两种可能的参数排序。

关系类型的选择是基于特殊货物本体中关系的广泛覆盖[39]。表2显示了关系类型的一个实例和一个例句。该数据集采用Semeval-2 Task8的标准格式[55],并在GitHub上公开可用。脚注5

表2关系类型的示例和示例句子,用作所建议模型的输入

现有数据集通常包含数百个目标关系类型的样本。在特殊货物运输等特定领域,生成数据集的成本很高。对于每种关系类型,我们只选择并注释了几个示例句子。两名领域专家独立注释每个句子。专家们对87%的案例持一致意见。我们在实验中应用商定的数据子集来评估两个多类分类器。表3显示了数据集的统计信息。

表3多类训练关系分类器生成的数据集统计

在SCRS数据集中,每个关系类型只有几个实例。scl是通过增加SCRS中关系类型实例的数量来生成的。我们将SCRS和SCRL数据集中相似的类结合起来,构建了两个数据集,即SCRSM和SCRLM。数据集在类之间具有最少的语义重叠,并作为域类的粗粒度表示。

在本节中,我们评估了基于分层多任务模型和BERT的拟议关系表示模型在特殊货物多类关系分类器性能中的效果。我们给出了在第4.3节中描述的数据集上使用F1分数的实验结果。

F1和Accuracy是广泛用于评价关系抽取和FewRel任务的性能指标[33,56,57]。准确性衡量的是在特殊货物领域中提取的关系的总体正确性,是评价模型性能的定量度量的重要指标。准确度计算为正确预测与所有类别的预测总数的比率。我们在不同的少量射击设置中计算模型的准确性,例如1射击或5射击分类或使用不同的生成支持集的方式。

(7)

在特殊货物信息提取任务中,仅仅准确性是不够的,因为它没有考虑到特殊货物关系提取器错误识别的关系和未识别的关系。另一方面,F1分数考虑了精度和召回率的调和平均值,使其成为我们领域中更好的信息提取评价指标。精度度量正确提取的正关系实例的数量占提取的正关系实例总数的比例。召回度量正确提取的关系实例的数量占数据集中关系实例总数的比例。F1对两个指标的权重是相等的。因此,它在准确率和召回率方面提供了对分类器性能的平衡评估。

(8) (9) (10)

关系分类器对BERT和BERT + MTB得到的关系表示的性能通过应用SCR数据集进行测量。实验中使用的模型超参数如表4所示。这个设置是为了使实验进行公平的比较。

表4超参数coBERT-ba中使用的配置Sed多类关系分类器

表5显示了使用/不使用MTB训练分类器的结果。我们研究了基于BERT-base和BERT-Large架构的分类器。由于使用了开始实体标记的相应表示形式的串联,因此我们将这些版本标记为SCREBERT(EM)。然后,将结果与使用MTB方法训练的领域数据的BERT变体进行比较。这些版本被标记为SCREBERT(EM)+MTB。

表5 e估值结果(F1)对特殊货物试验数据进行基于不同BERT配置的多类关系分类

综合评价,SCREBERT(EM)+MTB比SCREBERT(EM)获得更高的f1分。由于用于训练模型的生成语料库不足以训练MTB模型,因此这种改进并没有显着不同。由于相似关系实例的统一增强了分类器的识别能力,该模型对合并关系实例的处理性能较高。此外,利用BERT-Large可以提高性能,因为它是在大量数据集上训练的。因此,使用BERT-Large变压器应用具有粗粒度关系的大型数据集可以产生最高的性能。

数据集中的关系样本是双向设置的。例如,Ships关系有两个不同的变体,一个显示e1实体船e2实体(Ships(e1,e2)),另一个显示e2实体船e1实体(Ships(e2,e1))。我们衡量模型是否能够正确地检测关系,而不考虑方向。表6显示了没有方向的模型的评估。与考虑关系方向的情况相比,模型的性能得到了提高。在这种情况下,性能是使用分类在适当类别但方向不同的实例来计算的。在定向和非定向数据集上的两个实验中,我们看到在大数据集上训练的模型的性能之间没有很大的差距,大数据集的样本几乎是小数据集的两倍。此外,即使应用仅依赖于一般领域文本的BERT也会产生合理的性能。这表明在低资源领域使用表示学习是有效的。

表6 e估值结果(F1)基于BERT的非方向数据集的多类关系分类

在本节中,使用SCR数据集上的分层多任务模型开发的表示来检查多类关系分类器的效率。表7列出了评估中使用的模型的超参数。在所有评估中使用相同的设置,以确保公平的比较。

表7分层多任务模式下超参数的配置Sed多类关系分类器

在我们的实现中,除了用于嵌入输入的ELMOFootnote 6[44]、GloVeFootnote 7[43]和CNNFootnote 8[45]外,我们提出的基于分层注意的多任务架构还包括一个基于crf的序列标记层和一个带有注意层的BiLSTM。我们采用了PyTorch实现Matching The BlanksFootnote 9 (MTB)[33]来实现特殊货物领域的Bert-base关系提取器。我们在实现中应用了Python(3.6 +)、PyTorch(1.2.0 +)和Spacy(2.1.8 +)。由其他研究人员重新生成模型也很容易,因为很清楚数据是如何准备的,分类器是如何训练和实现的。代码和数据集也可以在GitHubFootnote 10平台上进行验证和重用。也可以为其他领域的类似问题轻松地定制和实现模型,并自动生成数据。

将层次模型用于特殊货物领域的特征提取,为多类关系分类器生成丰富的特征表示。表8显示了使用基模型提取的特征训练的分类器的实验结果。该模型在粗粒度和细粒度关系分类方面的性能都很好。

表8 e估值结果(F1)基于分层多任务模型的多类关系分类

多类关系分类器采用归纳迁移方法进行训练,具有良好的性能;然而,由于BERT使用了非常大的语料库进行预训练,因此评价结果不如BERT-base模型高。用于训练分层多任务表示模型的数据集比BERT的数据集要小;因此,增加域数据量将产生更高的性能。

为了评估模型对无向关系的有效性,进行了一组新的实验。表9说明了结果。结果表明,与之前的情景相比,该模型在各种数据集上获得了更高的f1得分。一种可能的解释是,不管名称实体的顺序如何,确定适当的类可以提高性能。

表9 e估值结果(F1)在非方向数据集上基于分层多任务模型的多类关系分类

实验结果也支持了这一观点,即通过分层多任务模型进行训练可以显著减少人工生成领域训练数据的工作量,从而减少关系提取器的创建和知识库的数量。

在少射关系匹配中,给定一个查询关系语句,对候选关系进行排序和匹配。我们在SCR数据集上评估了少镜头关系匹配任务。在这种情况下,点积作为查询的关系表示与每个候选语句之间的相似度评分。

少弹学习通常使用N-way-K-shot分类进行研究。这里,我们的目标是区分N个类,每个类有K个例子。表10和表11给出了在数据集的两种不同变体上的少射关系分类任务的评价结果。

表10 FewRel的few-shot关系分类精度

表11基于非定向的ferel_few -shot关系分类精度最终数据集

基于bert的分类器优于基于分层多任务学习的分类器。这可能是因为BERT在训练阶段使用了大型数据集。评价结果表明,当关系类型的多样性减少或每种关系类型的训练样本数量增加时,性能都有所提高。

实验结果表明了特殊货物关系表示模型在关系提取和少镜头关系匹配两个任务中的有效性。特殊的货物关系提取器在不同的数据集上提供了可比较的性能。仅通过预训练模型学习关系表示对特殊货物领域的效率有很大的影响,增加训练数据量对性能的影响并不显著。这明显减少了特定于领域的任务中的人工工作量。

由于多任务分层体系结构受益于任务内部的感应传输,因此它提供了从模型的最低层到最高层的补充表示。这将导致从架构的底部到顶部的简单特征流,从而加速训练过程。

我们可以用最少的人为干预,从特定领域的文本中自动为底层任务构建足够的数据集,并将其应用于多任务表示模型设置。由于底层任务只使用自动生成的特定于领域的数据进行训练,因此构建模型是有效、简单和廉价的。这种体系结构可以很容易地适应低资源的目标领域。整个模型可以端到端训练,不需要任何外部语言工具或手工设计的特征。

根据所使用的语言分析,自然语言处理(NLP)任务可以大致分为句法任务和语义任务,它们涉及语言分析和理解的不同方面[58,59]。语义任务指的是一系列涉及理解人类语言含义的任务,如命名实体识别(NER)和关系提取。句法任务则侧重于分析句子的语法结构和句法,如词性标注和句法分析[60]。当其组成部分的任务相关时,分层架构是最有效的[61]。由于最终目标任务是一个语义任务,因此所提出的多任务分层体系结构是在一组语义任务上设计的。该模型旨在将从NER到二元关系提取的一系列语义任务集成到一个单一的体系结构中。

多任务分层模型的层数取决于目标分类任务的复杂程度。我们根据目标任务的复杂程度来设计层,即多类关系提取。在[41,60]中讨论了NLP任务之间的语言层次。“低级”任务很简单,只需要对模型的输入进行有限的修改,而其他“高级”任务需要对输入进行更深入的处理,可能需要更复杂的体系结构。[61]中认为,假设需要较少知识和语言理解的低级任务最好保留在较低的层,使较高级别的任务能够利用较低级别任务的共享表示。原则上,在单一模型中训练语义任务的语言级别将使彼此受益。我们将这些知识纳入到层次结构中,并使用[41,60]中NLP任务的语言层次概念设计了3级多任务。因此,低级语义任务(例如NER)以无缝级联的方式影响高级语义任务(例如二进制关系提取)的表示。共享嵌入和堆叠分层编码器允许我们沿着模型的完整结构共享来自每个任务的监督,并实现最先进的性能。

BiLSTM模型中的注意层用于选择性地关注输入序列中与手头任务最相关的某些部分。注意层使用一种机制,根据输入序列的每个时间步对预测输出的重要性,为它们分配注意权重。然后使用这些权重来计算输入序列的加权和,从而捕获最重要的信息。在我们的模型中,所需的关注层是根据设计的体系结构中的任务数量来选择的。它们放在每个任务的顶部,以分层方式传递重要特性,并充当与其他任务的连接器。这种注意机制有助于模型更好地理解输入序列中不同部分之间的关系,从而提高模型预测的准确性。注意连接是模型性能的关键,因为它们将序列的重要部分提供给更高级别的任务,并帮助它们编码丰富的表示。

采用BERT对该方法进行了改进,并在高性能下运行。建立在基于bert的关系表示模型上的关系提取器优于分层多任务表示模型。一个潜在的原因是BERT训练中使用的训练数据的大小和领域。BERT在包含一般文本和特定领域文本的庞大语料库上进行训练,而分层多任务模型主要基于特定领域文本的有限数据集。虽然监督多任务学习模型可以通过在分层设置中利用不同的底层任务来编码输入句子的语言特征的丰富互补表示,但由于训练数据的大小,使得SCREHMTL很难取得实质性的成果。因此,在模型架构中增加训练数据的大小或利用丰富的编码资源(例如BERT和GPT-3[62])更有可能导致BERT之上的高效分层多任务模型。

从计算的角度来看,所提出的模型具有计算效率和成本效益。最佳模型在4 × Titan V, 12核12 GB HBM2上的训练时间小于20分钟。由于结构简单,训练数据集较小,训练分层多任务模型比基于bert的模型更容易,所需的数据和人力更少。因此,它们在任何训练数据有限的领域(如特殊货物运输)都是有效的。在基于分层注意的多任务架构中,我们使用卷积神经网络(CNN)来提取字符级特征,因为CNN在性能方面与递归神经网络(rnn)相似,但rnn的计算训练成本更高,如[63]所述。

在多任务环境下,训练速度加快[42]。这意味着与单任务模型训练框架相比,分层模型中每个任务的训练时间减少了。这样,执行任务所需的处理时间就缩短了。也就是说,实现收敛所需的更新次数减少了。这支持将从一个任务获得的特征传递给分层模型中的其他任务的洞察力。

为了获得特定于领域的关系嵌入,两个关系表示模型都使用特定于领域的训练语料库进行训练,而人工干预最少。增加调优数据的数量并不能显著提高模型的性能。因此,由于很少有人参与训练这些关系表示模型,因此它们在任何具有少量训练数据的领域(如特殊货物运输)都是有效的。

本研究为物流知识库的开发和设计以及特定领域数据的提取方法提供了思路。作为一种结构化资源,填充特殊货物本体为应用程序的范围、系统的不同组件以及它们之间的交互提供了有价值的见解。此外,该本体可以在系统的实际运行中使用。

例如,辉瑞疫苗需要在特定温度下运输,这一事实可以从特殊货物本体中推断出来,这意味着,当货运代理处理运输疫苗的请求时,系统可以确定货运服务需要包含要运输的疫苗的温度要求。

图9举例说明了如何将货物本体包含在物流智能系统的上下文中,并帮助规划特殊货物运输。当货运请求到达时,货运代理向特殊货物智能系统发送查询,以查找货运需求。所提出的关系表示模型可以作为知识库的一部分,并用作信息提取器,用于提取特殊货物本体(容器、制药、温度)概念的实例(辉瑞、Va-Q-Tec、?80°C),以填充本体并将其用于语义推理。我们的方法处理3.2节中解释的输入域信息,并以实体的形式输出三元组及其之间的关系(Pfizer, IsPackedIn, Va-Q-Tec), (Va-Q-Tec, hastemature, - 80°C)基于特殊货物本体IsPackedIn, hastemature中定义的关系。

图9

特殊货物本体在货物运输规划中的应用实例。所提出的关系表示模型可以作为信息提取器用于抽取特殊货物本体概念的实例

特殊货物本体用于推断疫苗必须在特定温度下运输。与数据库不同,本体不是一种只存储所需关系然后检索它们的模式。它可以用于提出在本体中没有显式表达的问题。辉瑞公司在- 80°C的存储条件在本体中没有明确表达,而是根据一定的规则和约束从现有事实中推断知识获得的,即辉瑞公司在Va-Q-Tec中包装,Va-Q-Tec温度为- 80°C, covid - 19疫苗在特殊温度下存储。推理的结果有助于货运代理在规划中进行决策。

因此,这种新颖的数据分析模型可以通过为物流中的许多智能应用提供一套解决方案,在货运代理行业中发挥重要作用。由于特殊产品(例如,不同类型的药品,如COVID-19疫苗)的复杂特性以及航空货运公司提供的能力和服务标准化的缺乏,这对托运人和货运代理来说是相当具有挑战性的。由于解决了这些限制并优化了组织问题的解决方案,因此应用与所提出的模型相似的模型对于获取和建模物流和货物知识至关重要。

运输需要特殊处理的商品的特殊货物空运急需数字化创新。在本文中,我们的目标是带来创新,以找到一种强大的方法来引出和建模相关信息。

用有限的数据训练一个有效的模型是具有挑战性的。缺乏具体的领域数据会使问题变得更糟。本文提出了基于BERT和分层多任务结构两种不同的表征学习模型的特殊货物领域关系提取方法。基于bert的关系表示仅依赖于实体链接的文本,应用MTB训练设置产生丰富的特定于领域的关系表示。多任务关系表示模型是在层次化的设置下,基于从顶层深层到底层浅层的不同任务建立的。然后将生成的表示集成到一个新的分类器中,并训练最终的模型。该模型可用于特殊货物领域本体填充过程中的关系分类。

为了评估所提出的模型,我们开发了一些特殊货物领域的数据集。实验结果表明,当处理特定领域的小型训练数据时,应用所提出的模型比增加数据规模更有效。因此,所提出的模型在低资源环境中特别有用,并最大限度地减少了在特定领域生成信息提取数据集的人为干预。

本工作是对特殊货物领域多类关系提取的初步研究之一。由于体系结构独立于领域,因此它们可以在其他领域中使用。在未来,我们打算利用外部知识资源以及我们的关系嵌入。此外,我们将考虑基于注意力的多任务模型在共同引用解析等领域任务中的表现。

下载原文档:https://link.springer.com/content/pdf/10.1007/s00521-023-08704-9.pdf